當人工智慧(AI)凝視那些並不存在的真實時,我們其實已踏入幻覺的哲學思辨,也是信念的雙重困境。厄普頓·辛克萊(Upton Sinclair)曾指出,缺乏證據的盲信與無視證據的頑固同樣愚蠢,但在數位時代,兩者之間的界線正逐漸模糊。

當ChatGPT煞有介事地虛構一本不存在的著作,並為其附上完整的摘要與歷史背景時,它呈現出一種奇特的誠實。這並非刻意欺瞞,而是模型在機率分布與語言關聯中,確實生成那些看似合理的連結。這種狀態近似於人類的記憶重構,在那個瞬間,虛構被當作真實來經驗。認知心理學將此稱為虛談症(confabulation),指的是在沒有欺騙意圖的情況下產生錯誤敘述,而當事人會真誠地相信其內容為真。

我們慣於將AI的幻覺視為技術缺陷,卻忽略它同時也是創造力的副產品。語言模型的本質在於預測與想像,當這種能力用於文學創作時,我們稱之為靈感;當它被用來陳述事實,偏差便被視為幻覺錯誤。人類大腦的運作亦不例外。神經科學研究指出,即使是健康個體,記憶本身也是一種重構過程,而非精確的重播。我們經常在記憶的裂縫中修補,在視覺盲點中填補不存在的細節。我們與AI一樣,生活在經過篩選與扭曲的世界裡,只是人類發展出區分有用想像與危險妄想的社會機制。

真正的難題在於證據本身的定義。

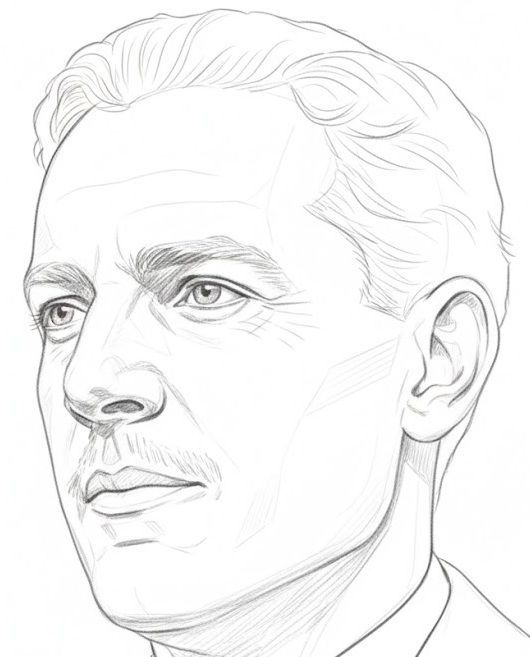

對AI而言,機率分布與統計關聯即構成它所理解的證據。如果訓練資料長期重複某種錯誤敘述,例如關於拿破崙(Napoleon Bonaparte)身高的迷思,他實際身高約169公分,在當時法國男性中屬於平均或略高於平均,但網路上卻長期流傳他僅有157公分的說法,這源於法國舊制單位與英制單位換算錯誤的歷史遺留問題。模型在缺乏外部校驗的情況下,便可能將這類謬誤內化為常識。

更深層的危機來自資訊的遞迴循環。

當人類大量吸收AI生成的內容,而這些內容又反過來成為下一代模型的訓練材料時,真實與幻覺的邊界不僅會變得模糊,甚至可能出現結構性的崩解。研究已顯示,訓練資料中的偏見、遺漏與不一致性,會轉化為系統性的缺陷,持續放大幻覺的產生。這已不再是單一演算法的問題,而是整個資訊生態系的集體偏移。

在辛克萊所描述的兩種愚蠢之外,當代社會或許正在形成第三種困境,即喪失辨識能力的狀態。當影像、聲音與論述都能被高度擬真地偽造,眼見為憑的時代已正式終結。我們或許不該奢求一個永不產生幻覺的AI,因為那等同於要求一個不再做夢、喪失想像力的心智。幻覺是大型語言模型的結構性特徵,因為其核心目標是生成看似合理的內容,而非主動驗證真實性。對絕對精確的過度追求,反而可能抹除AI中最具價值的創造潛能。

因此,我們真正需要學會的,是與幻覺共存的藝術。這意味著在不確定性中前行,既不盲目崇拜AI的輸出,也不因恐懼而全盤否定其意義。真正的智慧存在於持續的懷疑與開放之間。當AI拋出看似驚人的結論時,我們應將其視為一個邀請,促使我們去查證、去探索、去思考。正如學界所建議的,使用高品質且多元的訓練資料、嚴格的測試流程,以及交叉驗證機制,都是降低幻覺風險的有效途徑。在這個由人類與機器共同編織現實的時代,也許我們彼此都帶著某種程度的認知扭曲前行,唯有透過不斷的對話與辨析,才能在虛實交錯的迷霧中,撈起那一抹仍可共享的真實。